In de wereld van data-analyse zijn lineaire modellen en gegeneraliseerde lineaire modellen (GLM) krachtige hulpmiddelen om de effecten van factoren te begrijpen die u wilt onderzoeken. Hoewel deze modellen nuttig zijn voor het analyseren van gegevens die zijn verkregen uit HCI-experimenten (Human-Computer Interaction), is er een zorgpunt: ze houden niet altijd goed rekening met "repeated-measure"-gegevens, zoals individuele verschillen tussen deelnemers. Hier komen multilevelmodellen om de hoek kijken, die vaak worden aangeduid als "hiërarchische", "random-effect" of "mixed-effect" modellen. De term "random effects" kan verwarrend zijn, omdat deze verschillende betekenissen kan hebben. In deze uitleg volgen we de interpretatie uit het boek "Data Analysis Using Regression and Multilevel/Hierarchical Models" van Andrew Gelman en Jennifer Hill.

We zullen uitleggen wat "random effects" en "fixed effects" (het tegenovergestelde van random effects) betekenen. Het is belangrijk op te merken dat er verschillende meningen bestaan over deze concepten, zoals ook in het boek van Gelman en Hill wordt besproken. Daarom zullen we niet diep ingaan op de discussies over hoe deze factoren precies moeten worden beschouwd.

Basisconcepten van Multilevelmodellen

Voordat we duiken in voorbeelden van multilevel lineaire modellen, is het nuttig om een globaal begrip te krijgen van wat ze inhouden. Laten we een eenvoudig experiment overwegen: het vergelijken van twee technieken, Techniek A en Techniek B, waarbij de meting de prestatie- of reactietijd is. In uw experiment voerden 10 deelnemers taken uit met beide technieken, wat resulteert in een within-subject design.

Deze analyse houdt echter niet volledig rekening met het experimentele ontwerp: de verschillen tussen de deelnemers. Sommige deelnemers zijn bijvoorbeeld comfortabeler met het gebruik van computers dan anderen, wat hun algehele prestaties kan beïnvloeden. Of de verschillen tussen de technieken kunnen effecten veroorzaken die afhankelijk zijn van de deelnemers. Sommige deelnemers hadden vergelijkbare prestaties met beide technieken, terwijl anderen veel betere prestaties hadden met één techniek.

Multilevelregressie stelt ons intuïtief in staat om een model te hebben voor elke groep die wordt vertegenwoordigd in de within-subject factoren. In dit voorbeeld zou u dus niet één lineair model bouwen, maar 10 lineaire modellen, elk voor een individuele deelnemer, en analyseren of de technieken verschillen veroorzaakten. Op deze manier kunnen we ook rekening houden met individuele verschillen tussen deelnemers (deze zullen worden beschreven als verschillen in de modellen).

Wat multilevelregressie feitelijk doet, is een middenweg vinden tussen het volledig negeren van de within-subject factoren (met één model) en het bouwen van een apart model voor elke groep (wat resulteert in N afzonderlijke modellen voor N deelnemers). Deze overdreven vergelijking beschrijft echter goed hoe multilevelregressie verschilt van simpele regressie en is gemakkelijk te begrijpen.

Varying-Intercept versus Varying-Slope Modellen

Het vorige gedeelte gaf een ruw idee van wat multilevelmodellen zijn. Voor de factoren waarbij we rekening willen houden met individuele verschillen, behandelen we deze als random effects en bouwen we voor elk niveau van deze factoren een model. Er blijft echter een vraag over: als we voor elke deelnemer een apart model bouwen, zou de analyse dan niet erg tijdrovend zijn? Met het bovenstaande voorbeeld zouden we in totaal 10 modellen hebben. Sommige zouden significante effecten van de techniek kunnen laten zien, andere niet. Hoe kunnen we dan de resultaten generaliseren en zeggen of de techniek echt een significante factor is?

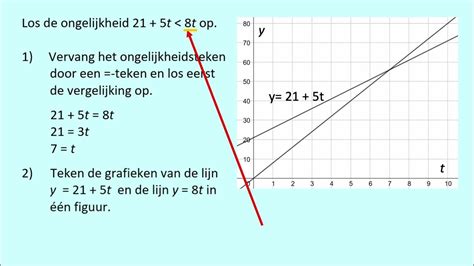

Multilevelmodellen kunnen dit probleem oplossen. In plaats van volledig verschillende modellen te bouwen, verandert multilevelregressie de coëfficiënten van slechts enkele parameters in het model voor elk niveau van de random effects. Grofweg zijn er twee strategieën die u kunt volgen voor random effects: varying-intercept of varying-slope (of beide).

Varying-Intercept

Varying-intercept betekent dat verschillen in random effects worden beschreven als verschillen in de intercepten. In het vorige voorbeeld zouden we 10 verschillende intercepten hebben (één voor elke deelnemer), maar de coëfficiënt voor de techniek blijft constant. In veel gevallen zijn factoren, meer precies onafhankelijke variabelen of predictoren, iets dat u wilt onderzoeken. Daarom wilt u resultaten generaliseren voor deze factoren. De intercept is meestal iets dat u niet in uw analyse opneemt, dus het kan erg ingewikkeld worden. Tenzij u duidelijke redenen heeft, zullen varying-intercept modellen voor u werken. Ze zijn niet computationeel ingewikkeld en de resultaten zijn eenvoudig te interpreteren.

Varying-Slope

Varying-slope modellen laten toe dat de relatie tussen een predictor en de uitkomstvariabele varieert tussen de groepen (bijvoorbeeld deelnemers). Dit betekent dat de helling van de regressielijn voor een specifieke predictor kan verschillen voor elke deelnemer.

Fixed Effects versus Random Effects

Hoewel we niet diep zullen ingaan op het verschil tussen "random effects" en "fixed effects" (het tegenovergestelde van random effects), is het belangrijk om een globaal begrip te hebben van hun verschillen. Dit is onze interpretatie van de verschillen tussen fixed en random effects:

In multilevelregressie bouwt u meerdere modellen. De coëfficiënten van de fixed effects zijn constant of "vast" over de modellen heen. In tegenstelling hiermee kunnen de coëfficiënten van de random effects verschillen, of (meer of minder) "random" zijn. Random effects kunnen factoren zijn waarin u niet geïnteresseerd bent, maar waarvan u de variantie uit uw model wilt verwijderen. "Deelnemers" zijn een goed voorbeeld van random effects. Over het algemeen zijn we niet geïnteresseerd in hoe verschillend de prestaties van elke deelnemer zijn. Als u een betere manier kent om het verschil tussen fixed effects en random effects te begrijpen, deel deze dan met ons!

Praktische Toepassing met R

Om multilevel lineaire regressie uit te proberen, hebben we hypothetische gegevens voorbereid. U kunt deze hier downloaden. Laten we een hypothetische context schetsen voor deze gegevens. We hebben een experiment uitgevoerd met een touchscreen desktopcomputer. Ons doel is om te onderzoeken hoe muisgebaseerde en touchgebaseerde interacties de prestatie- of reactietijd beïnvloeden in verschillende applicaties. In dit systeem konden deelnemers zowel muisklikken als directe aanraking gebruiken om een object of item in een menu te selecteren. Ze konden ook een muiswiel of een pinch-gebaar gebruiken om het scherm in of uit te zoomen. We lieten ze vrij kiezen welke manier ze wilden gebruiken om te interageren met het systeem, zodat we konden meten hoe mensen geneigd waren muisgebaseerde en touchgebaseerde interacties te gebruiken. Het bestand bevat de resultaten van dit experiment. De meeste kolommen zijn waarschijnlijk te raden.

- Time: De tijd (in seconden) om de taak in elke applicatie te voltooien (aangegeven door Application).

- MouseClick, Touch, MouseWheel, PinchZoom: Het aantal muisklikken, directe aanrakingen, zoomacties met het muiswiel en zoomacties met het pinch-gebaar.

Nu willen we onderzoeken hoe deze aantallen MouseClick, Touch, MouseWheel en PinchZoom de prestatie- of reactietijd beïnvloeden. We willen echter ook rekening houden met de effecten van ons experimentele ontwerp.

Wat Random(1|Participant) probeert te betekenen is dat we de intercept voor elke deelnemer gaan aanpassen. Ja, we maken varying-intercept modellen. We gaan ervan uit dat individuele verschillen tussen deelnemers verklaard kunnen worden door verschillen in de intercept. Er zijn verschillende manieren om multilevel lineaire regressie in R uit te voeren, maar we gebruiken het lme pakket. Nogmaals, (1|Participant) is het deel voor het random effect. "1" staat voor de intercept. Dit betekent dus dat we de intercept voor elke deelnemer aanpassen.

Om de modellen te vinden, gebruiken we de restricted maximum likelihood (REML). We zullen niet dieper ingaan op REML, maar in de meeste gevallen kunt u REML gewoon gebruiken.

Estimate Std.

U kunt de geschatte coëfficiënt voor elke factor zien, maar het is enigszins onduidelijk of deze echt significant is.

Laten we coefplot proberen. Helaas werkt coefplot uit het arm pakket niet met een lme object.

Een dikke en dunne lijn vertegenwoordigen de 1SD en 2SD intervallen.

Tot nu toe gaat alles goed. We hebben succesvol een model gemaakt en het lijkt erop dat we interessante resultaten hebben.

Statistische Significatie en Interpretatie

Als u de pagina over meervoudige lineaire regressie heeft gelezen, denkt u misschien dat we een ANOVA-test kunnen uitvoeren. Technisch gezien kan dat. Het is echter niet eenvoudig om dit te doen vanwege de random effects. In dit geval kunnen we niet echt zeker zijn of de teststatistiek F-verdeeld is. Er zijn verschillende pogingen gedaan om dit aan te pakken en een ANOVA-test bruikbaar te maken voor multilevelregressie, zoals de Kenward-Roger correctie. Het is echter betwistbaar of deze correctie goed genoeg is om aan te nemen dat de gecorrigeerde teststatistiek F-verdeeld is.

In plaats daarvan gebruiken we de Markov Chain Monte Carlo (MCMC) methode om de coëfficiënt en de hoogste waarschijnlijkheidsdichtheid geloofwaardige intervallen (HPD credible intervals) te schatten. Hier zullen we gedetailleerde discussies overslaan over wat MCMC doet en wat HPD geloofwaardige intervallen betekenen (dit zullen we later op een aparte pagina doen). We gebruiken het languageR pakket om MCMC uit te voeren. De parameter nsim is het aantal simulaties dat wordt uitgevoerd. MCMCmean is de opnieuw geschatte coëfficiënt door MCMC.

Zoals u in dit voorbeeld kunt zien, kunnen er relatief grote verschillen zijn tussen de schatting door REML en die door MCMC. Voor zover wij begrijpen, is de schatting door MCMC betrouwbaarder dan die door REML.

Zoals u in de resultaten kunt zien, heeft alleen MouseClick een significant positief effect op het verhogen van de prestatie- of reactietijd. De resultaten impliceren dus dat het verminderen van het aantal muisklikken de algehele taakvoltooiingstijd in de hier geteste applicaties kan verkorten. Het effect van PinchZoom (0.1278, 95% HPD CI: -5.1017, 5.276) is kleiner dan dat van MouseWheel (2.7309, 95% HPD CI: -3.8874, 9.867).

Tot slot, laten we ervoor zorgen dat we geen multicollineariteitsproblemen hebben. Voor lmer() kunnen we de vif() functie niet gebruiken. In plaats daarvan kunnen we de functie gebruiken die door Austin F. wordt aangeboden. In dit voorbeeld zijn we dus in orde. Een andere manier om multicollineariteit te onderzoeken, is door te kijken naar de correlatie van twee van de onafhankelijke variabelen.

Kopieer de bovenstaande code en plak deze in uw R-console. Voor de laatste twee items kunt u iets zeggen als: "MouseClick toonde een significant effect (p<0.05). Het is waarschijnlijk acceptabel om simpelweg de richting van elk significant effect (positief of negatief) te rapporteren als u niet echt geeft om de werkelijke waarde van de coëfficiënt."